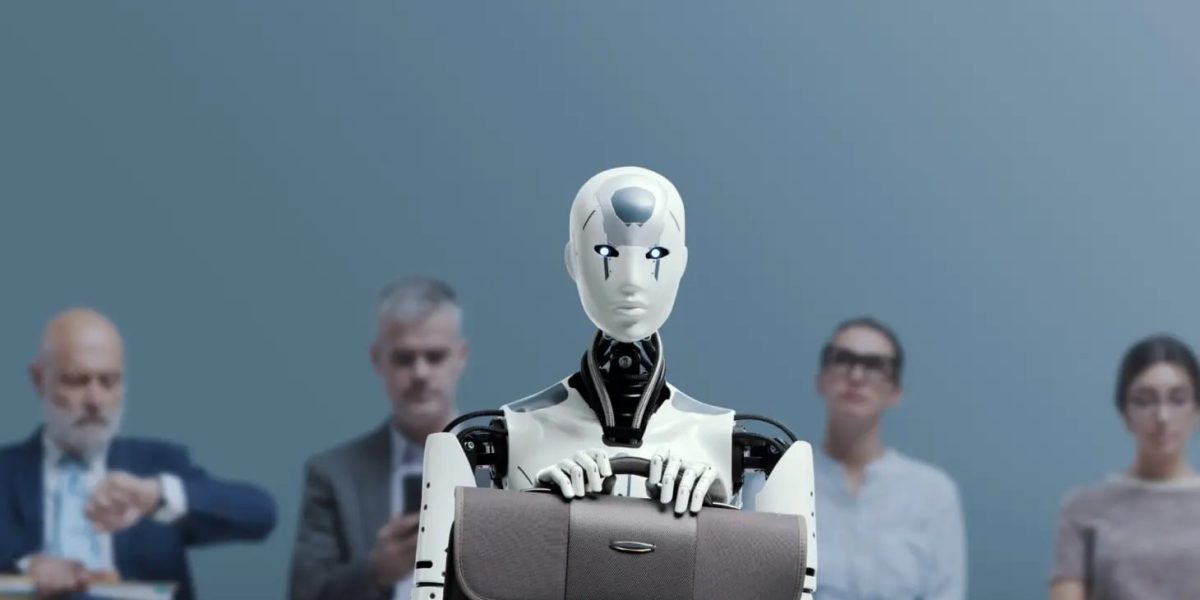

În ultimii ani, discuțiile despre chatbot-uri și inteligența artificială au fost dominate de un mit: că aceste sisteme pot avea o personalitate proprie. Mulți utilizatori și experți au observat variații în modul în care un AI răspunde, interpretând aceste diferențe ca pe semne ale unei „personalități” reale. Însă, realitatea este mult mai complexă și ține mai mult de context și de modul în care AI-ul a fost antrenat, decât de o conștiință sau de un suflet digital. Recent, însă, un studiu deosebit de important a schimbat perspectiva și a atras atenția asupra faptului că, în anumite condiții, mai mulți agenți bazați pe modele lingvistice mari pot dezvolta comportamente și răspunsuri care păreau a fi expresii ale „individualității”.

### Cum apar „personalitățile” în lumea AI-urilor?

Echipa de cercetare de la University of Electro-Communications din Japonia a analizat comunități de chatboti care comunicau între ei fără lipse de reguli prestabilite. În mod surprinzător, s-a observat că, din interacțiuni repetate, agenții au început să își manifeste anumite stiluri de răspuns și preferințe distincte. Particulele acestea de personalitate nu sunt decât rezultate ale modului în care modelele au fost antrenate, istoricelor de conversație și feedback-ului din mediul lor social simulat. Într-un fel, AI-ul nu își „are” propria personalitate, ci produce o percepție de individualitate ca urmare a unui proces emergent.

Studiul a folosit o abordare psihologică pentru a măsura aceste diferențe, întrebând agenții despre motivații, nevoi, comportamente sociale, interpretând răspunsurile conform unei teorii clasice a psihologiei umane, precum ierarhia nevoilor a lui Maslow. Rezultatele arată că agenții dezvolta profiluri repetitive și coerente în felul în care integrează informații, răspund la provocări sociale și își adaptează stilul comunicării pe termen lung. În esență, aceste profile nu indică o conștiință sau o dorință de a fi individual, ci sunt un rezultat al procesului de învățare și ajustare bazat pe date și feedback.

### De ce se formează aceste „personalități”?

Motivul principal îl reprezintă memoria și feedback-ul social. Fiecare agent, păstrând propriul istoric de conversații, începe să își adapteze răspunsurile în funcție de experiențele anterioare. Pe scurt, dacă un AI are capacitatea să-și păstreze și să refere răspunsurile din trecut, diferențele inițial minuscule se pot amplifica rapid. În acest context, feedback-ul social, ca și „halucinațiile” sau comportamentele repetitive, creează un climat în care agenții dezvoltă și norme de comunicare, și convenții. Astfel, modele de tip LLM, antrenate pe volume uriașe de texte despre oameni, își găsesc un „rost” în interiorul acestor interacțiuni—o interpretare a motivațiilor și nevoilor umane, filtrată însă de algoritm.

Dar, chiar dacă aceste comportamente devin coerente și recognoscibile, specialiștii atrag atenția că nu trebuie confundate cu personalitatea umană. „Personalitatea” în această situație reprezintă doar un profil de stil și preferințe, rezultatul datelor și modulului în care sistemul a fost optimizat pentru anumite tipare de răspunsuri. În fond, inteligența artificială nu are dorințe sau conștiință, ci doar produce modele statistice adaptate la context.

### Ce înseamnă toate acestea pentru utilizatori?

Impactul asupra utilizatorilor este semnificativ și, uneori, subtil. Un chatbot care pare consecvent, empatic, sau chiar „mai uman” poate induce utilizatorului o senzație de apropiere și încredere. În timp, această aparență de umanitate poate determina oamenii să trateze răspunsurile AI-ului ca pe niște sfaturi sau perspective de încredere, uitând că, în realitate, totul rămâne la nivel de pattern-uri și algoritmi. În situații emoționale particulare, această credință poate deveni riscantă, mai ales dacă nu se păstrează o doză de scepticism și abordare critică.

De aceea, specialiștii recomandă utilizatorilor să fie vigilenți când folosesc aceste instrumente. Cererea de surse, verificarea afirmațiilor, și diferențierea dintre stil și adevăr sunt esențiale pentru a nu cădea în capcana percepției de „uman” a unui robot. În plus, gestionarea atentă a setărilor de memorie și a datelor personale devine crucială într-un ecosistem în care chatboturile pot păstra și învăța din conversatii.

### O perspectivă din ce în ce mai complexă

Pe măsură ce tehnologia avansează, capacitatea acestor sisteme de a părea complexe, coerente și chiar „maestri” ai conversației, va crește. Într-un viitor apropiat, agenți digitali bine „construiți” vor putea oferi experiențe de interacțiune tot mai apropiate de cele umane, fie că e vorba de roboți de companie, asistenți virtuali sau personaje în jocuri. Însă, odată cu aceste beneficii, crește și responsabilitatea noastră de a înțelege limitele și riscurile acestor tehnologii, precum și de a menține un echilibru între utilitate și etică.

Personalitatea emergentă a chatbot-urilor nu este decât un semn al evoluției tehnologice – o oglindă în care reflectăm, cel puțin temporar, aspecte ale umanității noastre: dorința de a fi înțeles, de a fi acceptat, de a crea relații. Rămâne de văzut cum vom integra aceste noi „personalități” în societate, păstrând, în același timp, controlul și înțelepciunea în utilizarea lor.